La capacidad de la inteligencia artificial de generar conversaciones con humanos ha sido algo revolucionario, sin embargo, algunos buscan ir más allá buscando desarrollar un modelo que pueda detectar el estado de ánimo de una persona, como es el caso de Hume.

Se trata de una IA conversacional especializada en comprender las expresiones emocionales derivadas del uso y tono de las palabras, así en tiempo real es capaz de detectar si su interlocutor está triste, preocupado, emocionado o angustiado.

Un avance tecnológico significativo que puede ofrecer numerosas ventajas, como mejorar la interacción entre humanos y máquinas o proporcionar asistencia personalizada, sin embargo, también conlleva potenciales riesgos que merecen ser analizados.

Por qué el avance podría llevar a una antropomorfización de la IA

La capacidad de comprender e identificar emociones y además sostener conversaciones de las mismas puede llevar a una antropomorfización de la IA, que incluye atribuirle pensamientos y una personalidad a una máquina que no posee estas características.

Este fenómeno se manifiesta en cómo las personas hablan de la IA, en las expectativas que tienen sobre su comportamiento o en la forma en la que diseñan y presentan estos sistemas, otorgándoles nombres, géneros, o incluso creando representaciones visuales que les confieren aspecto humano.

De hecho, un riesgo significativo es el impacto psicológico porque la interacción prolongada con una inteligencia artificial que conozca nuestras emociones podría afectar la capacidad para interactuar y empatizar con otros seres humanos, socavando las conexiones personales y fomentando un sentido de aislamiento.

Finalmente, existe el peligro de la manipulación, debido a que con un entendimiento profundo de nuestros estados de ánimo y preferencias, la IA podría ser usada para influir en decisiones, desde las compras hasta las opiniones políticas, presentando un riesgo potencial para la autonomía individual.

Por qué el efecto Eliza es clave para entender estos riesgos

El efecto Eliza es un fenómeno específico relacionado con la antropomorfización de la IA. Se originó con ELIZA, uno de los primeros programas de chatbot desarrollado por Joseph Weizenbaum en la década de 1960, con el objetivo de simular una conversación mediante la paráfrasis de las entradas del usuario en preguntas o comentarios, lo que daba la impresión de que el sistema realmente entendía la conversación.

El modelo usaba un script llamado DOCTOR que simulaba una sesión con un psicoanalista, principalmente reorganizando las declaraciones del usuario en preguntas y presentándolas de vuelta al usuario.

A pesar de su simplicidad, muchos usuarios comenzaron a atribuirle capacidades de comprensión y emociones, creyendo que ELIZA era capaz de entender sus problemas y empatizar con ellos.

Este fenómeno demostró cómo las personas pueden asignar cualidades humanas a la tecnología, incluso cuando saben que están interactuando con un programa informático.

Qué otros riesgos implica una IA que reconozca emociones

Uno de los principales peligros que implica una IA capaz de reconocer emociones es la privacidad de los datos. Esta tecnología necesita procesar una gran cantidad de información personal para entender y predecir nuestros estados de ánimo, lo que plantea la preocupación sobre cómo se recopilan, almacenan y utilizan estos datos.

Además, el riesgo de que la información sensible caiga en manos incorrectas o se use de manera inapropiada es una realidad.

En el caso de utilizar la IA para la interpretación de emociones, esta podría conducir a errores o malentendidos. La comprensión emocional humana es compleja y matizada, y aunque la IA puede identificar patrones generales, puede no captar completamente las sutilezas de la interacción humana, resultando en respuestas inapropiadas o decisiones equivocadas.

En resumen, mientras las capacidades emocionales de la IA ofrecen posibilidades emocionantes, es crucial abordar estos riesgos de manera proactiva para asegurar que su desarrollo y uso se realicen de manera ética y segura, colocando la protección y el bienestar de los usuarios en el centro de las preocupaciones.

Últimas Noticias

Cómo detectar si un smartphone está siendo espiado y qué medidas de protección sirven

El malware instalado desde apps no oficiales es una de las vías más comunes para espiar un teléfono móvil

Caché de WhatsApp: por qué debes eliminarla y cómo hacerlo

La aplicación acumula archivos temporales y multimedia que pueden ocupar varios gigabytes si no se gestionan

Los escolares en Inglaterra están perdiendo habilidades de razonamiento debido a la IA, revela encuesta

El 49% de los docentes se opone a la introducción de tutores de IA propuestos por el gobierno británico

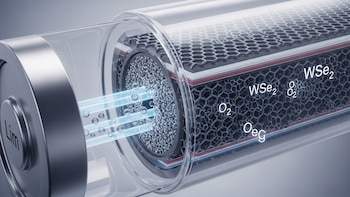

Esta nueva tecnología de baterías de litio-aire promete almacenar hasta 10 veces más energía

La innovación permite que la batería mantenga más de 550 ciclos de carga y descarga estables, superando a los catalizadores tradicionales

La IA Gemini mejora su capacidad para comprender tus órdenes gracias a esta actualización de Google Home

El asistente distingue entre dispositivos similares, como lámparas y luces, agilizando la ejecución de comandos