En internet, circulan videos de personajes públicos que resultan ser un deepfake, es decir, una manipulación digital creada con inteligencia artificial para simular situaciones que nunca ocurrieron.

Este tipo de incidentes subrayan la creciente preocupación en torno a la seguridad de los contenidos que se consumen en línea, especialmente en el ámbito de la publicidad y anuncios.

En este contexto, durante 2023, Google detuvo más de 5.5 mil millones de anuncios maliciosos, entre ellos, aquellos que usaron deepfakes, para ofrecer una experiencia segura y positiva a los usuarios y proteger el ecosistema publicitario.

La gigante tecnológica publicó su último reporte de seguridad de anuncios. Este documento tiene como objetivo hacer un balance y reforzar las medidas de seguridad para proteger a los usuarios de posibles engaños y la desinformación que proliferan a través de anuncios maliciosos o manipulados.

Deepfakes, una amenaza para las seguridad en línea

Los deepfakes son peligrosos porque utilizan inteligencia artificial para crear videos o audios falsos que parecen reales, lo que puede llevar a la desinformación, afectar la reputación de personas, manipular la opinión pública, y ser utilizados en fraudes y estafas, socavando la confianza en los medios digitales.

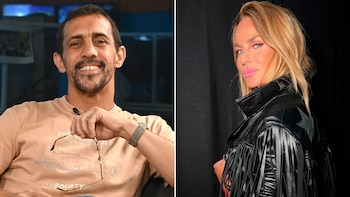

“Hacia finales de 2023 y entrando en 2024, nos enfrentamos a una campaña dirigida de anuncios que presentaban la imagen de figuras públicas para estafar a los usuarios, a menudo mediante el uso de deepfakes”, según indica Google.

Si bien en el reporte no hay información de cuantos deepfakes en anuncios se identificaron, Google señala que desplegó una estrategia con el fin de reconocerlos y eliminarlos.

“Identificamos patrones en el comportamiento de los actores maliciosos, entrenamos nuestros modelos de aplicación automatizada para detectar anuncios similares y comenzamos a eliminarlos a gran escala”, explican.

Una época reinada por la IA

En 2023, las estafas y fraudes en todas las plataformas en línea estaban en aumento, indica Google. “Los actores maliciosos están constantemente evolucionando sus tácticas para manipular la publicidad digital con el fin de estafar tanto a personas como a negocios legítimos”, agrega.

Aparte de los deepfakes, la inteligencia artificial puede tener varias aplicaciones en la elaboración de anuncios fraudulentos, tales como:

- Generación de Texto: La IA puede crear textos persuasivos o engañosos para promocionar estafas, ofrecimientos falsos o productos inexistentes.

- Reconocimiento y Análisis de Imágenes: Puede utilizarse para alterar imágenes o crear visualizaciones que confundan o engañen al espectador, mostrando productos de manera falsa.

- Segmentación Dirigida: Utilizando algoritmos para analizar grandes cantidades de datos, la IA puede identificar y dirigirse a usuarios vulnerables o más susceptibles a ciertos tipos de estafas.

- Simulación de Comportamientos Humanos: Bots inteligentes que simulan conversaciones humanas pueden ser utilizados en chats en línea para simular servicio al cliente o asesores, con el fin de engañar a los usuarios para que entreguen información personal o financiera.

- Análisis Predictivo: Para identificar cuándo y dónde es más probable que ciertos tipos de anuncios fraudulentos tengan éxito, optimizando así el impacto de actividades fraudulentas.

Google implementó una serie de políticas para reforzar la seguridad y protección de los usuarios en línea. Entre estas medidas se incluyó el lanzamiento de la política de Servicio Limitado de Anuncios en noviembre de 2023, diseñada específicamente para proteger a los usuarios limitando el alcance de los anunciantes con los que hay menor familiaridad.

Esta política es parte fundamental de los esfuerzos de Google para proteger a las personas de daños en línea, lo cual depende en gran medida de la capacidad de la compañía para responder rápidamente a nuevas tendencias de estafa.

Google restringió 6.9 mil millones de anuncios en 2023 en áreas sensibles, como servicios financieros y contenido para adultos.

Anuncios fraudulentos en época electoral

En un año con varias elecciones importantes mundialmente, Google ha implementado verificaciones de identidad y requisitos de transparencia para los anunciantes electorales, además de lanzar un nuevo requisito de divulgación para anuncios electorales que contienen contenido sintético, enfocándose en proporcionar mayor transparencia y permitir decisiones informadas.

Últimas Noticias

Estudiantes utilizan gafas con inteligencia artificial para copiar en exámenes: las alquilan por hora

Estos dispositivos, que pueden alquilarse por entre 6 y 12 dólares diarios, imitan la apariencia de unas gafas convencionales

La tienda de apps de ChatGPT no logra su éxito pese a sus cientos de alianzas: aún no convence

Aunque la compañía presume de contar con más de 300 integraciones disponibles en su tienda de aplicaciones, la mayoría permanece oculta

Sora, el generador de video de OpenAI, habría gastado un millón de dólares diarios

La decisión refleja la estrategia de la compañía de priorizar proyectos enfocados en el ámbito laboral y la productividad, tal como ha sucedido con Gemini

Artemis 2: así es la tecnología del cohete SLS que llevará astronautas a la Luna tras más de 50 años

Es el cohete más potente en operación y será clave para el programa Artemis, que buscará instalar bases permanentes en el satélite natural

Instagram quiere que veas las historias de tu ex, sin que él o ella lo sepa, con este truco

Meta está probando un modelo de suscripción que agregaría funciones para los usuarios