Dos accidentes con consecuencias trágicas de autos NIO que circulaban bajo el sistema Navigate on Pilot (NoP), la versión equivalente de esta marca al Autopilot de Tesla, han puesto en el ojo de la tormenta este tipo de sistemas de conducción autónoma en las últimas semanas.

Los siniestros viales ocurrieron en modelos diferentes de la marca china, y en diversas situaciones, circulando por autopistas de ese país. Uno fue el 30 de junio, en Shanghai, protagonizado por un modelo NIO EC6, y el otro, el 12 de agosto, en este caso con el SUV NIO ES8. En ambos casos, el sistema NoP no detectó un obstáculo detenido en el carril por el que circulaban los autos y eso generó el impacto. El primero fue con un montículo de piedras de una reparación vial, y el segundo, con un vehículo de asistencia de autopistas que estaba detenido reparando un inconveniente sobre el asfalto.

Mientras se continúan con las pericias y los procesos judiciales y penales que corresponden a accidentes con víctimas mortales y con demandas contra la compañía, una de las primeras respuestas de NIO fue aclarar que el sistema Navigate on Pilot, no es un sistema autónomo permanente para todo tipo de circunstancias, sino un asistente que puede guiar el auto en el tránsito fluido, incluso cambiando de carriles para optimizar la circulación, pero que no está programado para obstáculos detenidos, y que por esa razón, el conductor siempre debe mantener las manos en el volante.

En EE.UU. las autoridades de la Administración Nacional de Seguridad del Tráfico en las Carreteras (NHTSA) están investigando a Tesla por considerar que su sistema Autopilot no detecta apropiadamente los vehículos de asistencia detenidos en las banquinas, lo que vuelve a poner en la mesa de debates la seguridad pero sobre todas las cosas, la legislación sobre responsabilidad del sistema o de los conductores ante un accidente cuando se está circulando con el sistema de asistencia completa a la conducción.

Como explicó la doctora en Ciencias de la computación de la UBA y Experta en Inteligencia Artificial y Robótica, Marcela Riccillo en una nota publicada por Infobae una semana atrás, “Las máquinas aprenden lo que el hombre les enseña, no están para reemplazar al hombre, sino para complementarlo.”

En ese proceso está la tecnología en Inteligencia Artificial actualmente. El de enseñar a los sistemas que controlan los vehículos autónomos de Nivel 3, que exige que el conductor está totalmente a disposición de tomar el mando cuando el sistema así lo requiera, qué es un obstáculo, cómo puede presentarse y qué acciones tomar en consecuencia. Entre los sensores, los radares, los radares Lidar y las cámaras, los automóviles tienen cada vez mayor cantidad de datos para procesar y actual en consecuencia, pero la combinación de todos esos parámetros, ante imprevistos “no programados” puede causar este tipo de accidentes.

La presencia de un montículo de piedras, dependiendo de su altura podría considerarse un obstáculo o no, según cómo lo detecten los sistemas del automóvil. ¿El error es del sistema, del conductor que no imaginó que eso no sería detectado, o de los responsables viales si no lo señalizaron correctamente para evitar un accidente?

Con solo imaginar que un montículo de esas características podría haber sorprendido también a un conductor humano y causar un accidente similar o peor, porque en una maniobra evasiva de último momento podría haber involucrado a otros vehículos, se puede comprobar que ese quizás hubiera sido un accidente posible para cualquier conductor al comando de su automóvil.

También hay que programar el tiempo de respuesta de acuerdo a la velocidad a la que se circula. A bajas velocidades, el sistema automático de frenado de emergencia suele actuar correctamente, pero si cualquier conductor hace la prueba de superar los 100 km/h con un automóvil que disponga de Nivel 2 de asistencias como existe hoy en todos los países del mundo y con una gran variedad de modelos, comprobará que el sistema detecta y comienza a frenar mucho después de lo que el criterio del ser humano lo habría hecho.

“El ser humano tiene criterio, es sensible, tiene sentido común. No nacemos sabiendo todo, vamos aprendiendo, pero podemos ver una situación determinada e inesperada y tomar una decisión en base a esa capacidad que tenemos de discernir. La máquina siempre va a hacer lo que se le ha dicho o enseñado que haga”, señaló Marcela Riccillo, recordando que es el ser humano quién al final del día, es el responsable de lo que las máquinas autónomas y robots ejecutan como tarea.

Basta con imaginar otro tipo de casos menos sofisticados, como creer que por tener un 4x4 se puede pasar por cualquier tipo de dificultad, y echarle la culpa al fabricante cuando el vehículo se ha quedado encajado en un lugar para el cual no fue preparado para circular, se puede entender que aún el ser humano falla en discernir ante ciertos peligros.

¿Entonces de quién es la responsabilidad de estos accidentes?

SEGUIR LEYENDO

Últimas Noticias

Cómo el calor afecta el rendimiento de tu auto: claves para evitar el desperdicio de combustible

Tomar ciertas precauciones y modificar algunos hábitos puede marcar la diferencia al conducir en condiciones de altas temperaturas, reduciendo el gasto y previniendo averías costosas

El mantenimiento inadecuado aumenta los probabilidad de incendios vehiculares en El Salvador

Las advertencias incluyen la importancia de realizar inspecciones periódicas en talleres certificados y equipar cada unidad con extintor adecuado, prácticas que han contribuido a una baja en la tasa de emergencias reportadas durante el último año

Las compras de autos chinos aumentan pese a caída general de importaciones en República Dominicana

El flujo de vehículos desde China hacia el país creció significativamente dentro de un contexto en que la entrada total de automóviles nuevos y usados experimentó descensos y modificaciones en la estructura de abastecedores

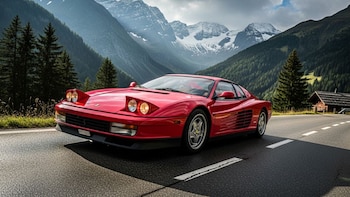

Una Ferrari y el récord mundial por la multa de tránsito más cara de la historia

En Suiza, un auto de alta gama fue sancionado con una cifra inédita por exceso de velocidad. El suceso quedó registrado en el Guinness World Records

Ni 28 ni 30: cuál es la presión ideal para las ruedas del auto antes de salir a la ruta

Tener la presión apropiada de los neumáticos influye en la seguridad, la estabilidad y el consumo de combustible durante los viajes largos